InstitutsCluster I

|

Das SCC betrieb ein von der DFG (http://www.dfg.de) gefördertes und mit mehreren Instituten des KIT gemeinsam beschafftes Computersystem mit dem Namen InstitutsCluster I.

|

|

Konfiguration des InstitutsCluster I

Der InstitutsCluster I beinhaltete

- 2 Login-Knoten mit jeweils 8 Cores mit einer theoretische Spitzenleistung von 85,3 GFLOPS und 32 GB Hauptspeicher pro Knoten,

- 200 Rechenknoten mit jeweils 8 Cores mit einer theoretische Spitzenleistung von 85,3 GFLOPS und 16 GB Hauptspeicher pro Knoten

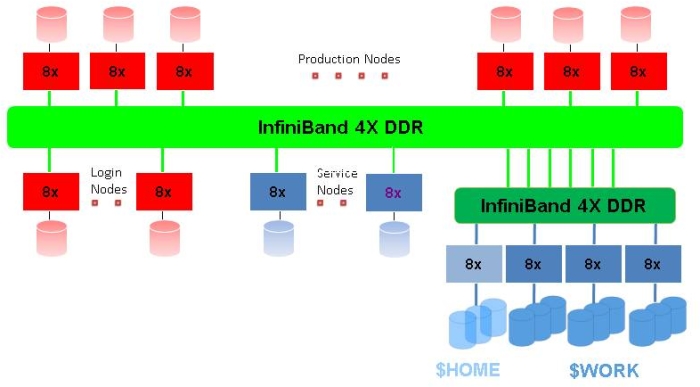

- und als Verbindungsnetzwerk ein InfiniBand 4X DDR Interconnect mit ConnectX Dual Port DDR HCAs..

Der InstitutsCluster I war ein hybrider massiv paralleler Parallelrechner mit insgesamt 206 Knoten, Alle Knoten (bis auf die Service-Knoten) hatten eine Taktfrequenz von 2,667 GHz. Alle Knoten besaßen lokalen Speicher, lokale Platten und Netzwerkadapter. Ein einzelner Rechenknoten hatte eine theoretische Spitzenleistung von 85,3 GFLOPS, so dass sich eine theoretische Spitzenleistung von 17,57 TFLOPS für das gesamte System ergab. Der Hauptspeicher über alle Rechenknoten hinweg betrug 3,3 TB. Alle Knoten waren durch ein InfiniBand 4X Interconnect miteinander verbunden.

Das Basisbetriebssystem auf jedem Knoten war ein Suse Linux Enterprise (SLES) 11 SP 1. Als Managementsoftware für den Cluster diente KITE; KITE ist eine offene Umgebung für den Betrieb heterogener Rechencluster.

Als globales Dateisystem war das skalierbare, parallele Dateisystem Lustre über ein separates InfiniBand Netzwerk angebunden. Durch die Nutzung mehrerer Lustre Object Storage Target (OST) Server und Meta Data Server (MDS) wird sowohl eine hohe Skalierbarkeit als auch eine Redundanz beim Ausfall einzelner Server erreicht. Es standen ca. 380 TB an Plattenplatz zur Verfügung, auf die allerdings auch weitere Rechner zugreifen konnten. Daneben war jeder Knoten des Clusters mit 4 lokalen Platten für temporäre Daten ausgestattet.

Detaillierte Kurzbeschreibung der Knoten und des Verbindungsnetzwerks:

6 acht-Wege (Login-)Knoten mit jeweils 2 Quad-Core Intel Xeon X5355 mit einer Taktfrequenz von 2,667 GHz, 32 GB Hauptspeicher und 4x250 GB lokalem Plattenplatz; 200 acht-Wege (Rechen-)Knoten mit jeweils 2 Quad-Core Intel Xeon X5355 mit einer Taktfrequenz von 2,667 GHz, 16 GB Hauptspeicher und 4x250 GB lokalem Plattenplatz und 5 8-Wege Service-Knoten mit jeweils 2 Quad-Core Intel Xeon E5345 mit einer Taktfrequenz von 2,3 GHz, 8 GB Hauptspeicher und 4x250 GB lokalem Plattenplatz. Ein einzelner Quad-Core Prozessor hatte 2 x 4MB Cache, betrieb den System Bus mit 1333 MHz und den FrontSideBus (FSB) mit 1066 MHz.

Als Verbindungsnetzwerk diente ein InfiniBand 4x DDR Switch (288 Ports) von Flextronics (F-XR430095) mit einer Gesamtdurchsatzrate von 288 x 40 Gb/s = 11,5 Tb. Als Adapter wurden ConnectX IB HCAs (Dual Port DDR, PCIe2.0x8 2,5GT/s) eingesetzt.