-

KI-Toolbox

-

Die KI-Toolbox bietet KIT-Mitarbeitenden einen komfortablen, web-basierten Zugang zur Nutzung von künstlicher Intelligenz (KI) über verschiedene, große Sprachmodellen (Large Language Models, LLM). Es stehen lokale Modelle mit maximaler Datenschutzsouveränität zur Verfügung, die ausschließlich am SCC betrieben werden. Zusätzlich sind Modelle über Azure OpenAI für generische Aufgaben verfügbar ohne personenbezogene Rückschlüsse und ohne Verwendung eingegebener Daten zum Modelltraining. Voraussetzung für den Zugang zur KI-Toolbox ist das erfolgreiche Absolvieren der KI-Schulung auf KOALA.

- Kontakt:ki-toolbox@scc.kit.edu

Zugangsvoraussetzungen

Der Zugang ist für KIT-Mitarbeitende, KIT-Studierende (ab April 2026) und Personen mit Gäste-und-Partner-Konto möglich.

Der Zugang zur KI-Toolbox setzt den erfolgreichen Abschluss des Selbstlernkurs "Verstehen und Anwenden von generativer KI" auf KOALA (Mitarbeiter) bzw. der ILIAS-Lernplattform (Studierende) voraus. Nach Abschluss der Schulung und erneutem Login in die KI-Toolbox wird der Zugang automatisch freigeschaltet.

Bitte beachten Sie vor der Nutzung unbedingt die Nutzungsbedingungen und die Datenschutzerklärung der KI-Toolbox.

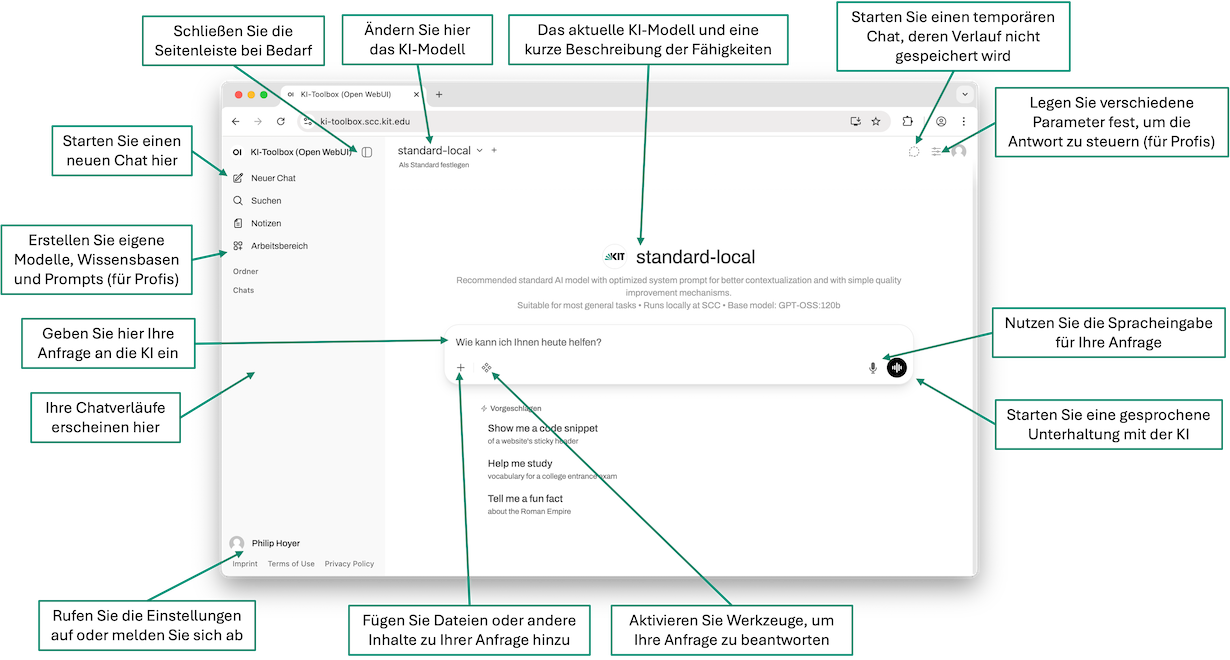

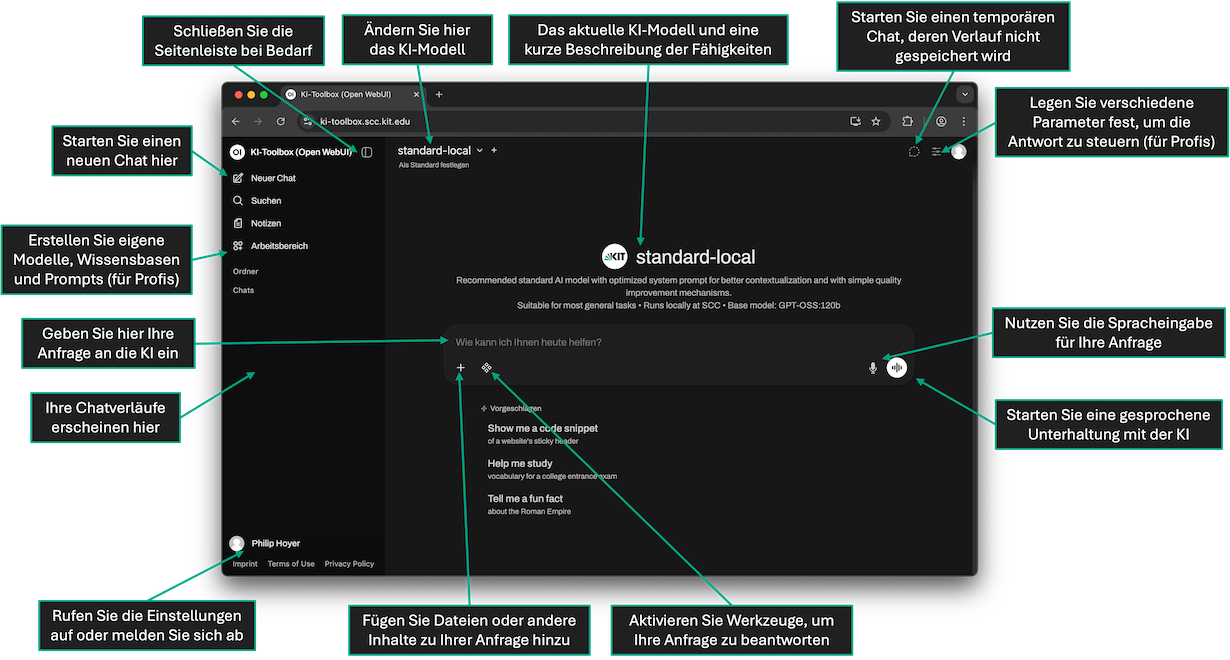

Schnellstart

- Bitte absolvieren Sie zunächst den Selbstlernkurs "Verstehen und Anwenden von generativer KI" auf KOALA (Mitarbeitende) bzw. auf der ILIAS-Lernplattform (Studierende). Der erfolgreiche Abschluss des Kurses ist zwingende Zugangsvoraussetzung zur KI-Toolbox.

- Rufen Sie in Ihrem Browser https://ki-toolbox.scc.kit.edu auf, klicken Sie auf "Mit KIT-Account fortfahren" und melden Sie sich an.

- Akzeptieren Sie ggf. die Datenschutzerklärung und Nutzungsbedingungen (nur bei der ersten Anmeldung)

- Erstellen Sie ggf. einen neuen Chatverlauf indem Sie in der linken Seitenleiste auf "Neuer Chat" klicken.

- Ändern Sie ggf. das gewünschte KI-Modell, indem Sie oben auf der Seite das Dropdown für die Modellauswahl öffnen.

- Geben Sie Ihre Anfrage im mittleren Bereich der Seite ein ("Wie kann ich Ihnen heute helfen?") und drücken Sie Enter zum Absenden.

KI-Modelle

Aktuell stehen in der KI-Toolbox verschiedene KI-Modelle zu Auswahl zur Verfügung. Lokale Modelle werden am SCC gehostet werden, während externe Modelle aktuell aus der Azure-Cloud in europäischen Rechenzentren bezogen werden.

Standard-Modelle

Für Nutzende mit wenig Erfahrung im Umgang mit KI-Modellen stellen wir zwei Modelle mit optimiertem System Prompt zur Verfügung:

- Wir empfehlen zunächst das Modell "Standard-Lokal" auszuprobieren. Dieses nutzt das lokale Modell "GPT-OSS 120B" und kann daher auch für den Umgang mit personenbezogenen Daten eingesetzt werden.

- Für komplexere Aufgaben ohne personenbezogene Daten kann das Modell "Standard-Extern" genutzt werden, dieses nutzt das OpenAI-Modell "GPT-5 mini" aus der Azure Cloud.

Liste aller Modelle

| Modell | Model-ID | Host | Kosten 1M Token | Intelligenz | Geschwindigkeit | Hinweise |

|---|---|---|---|---|---|---|

| GPT-OSS 120B | kit.gpt-oss-120b | KIT | - | mittel | sehr hoch | |

| Mixtral 8x22B Instruct | kit.mixtral-8x22b-instruct | KIT | - | mittel | hoch | (1) |

| Mistral Small 4 119B | kit.mistral-small-4-119b | KIT | - | mittel | sehr hoch | |

| Gemma 4 31B IT | kit.gemma-4-31b-it | KIT | - | mittel | mittel | |

| Qwen3.5 397B A17B | kit.qwen3.5-397b-A17b | KIT | - | hoch | hoch | |

| MiniMax M2.5 229B | kit.minimax-m2.5-229b | KIT | - | hoch | hoch | (1) |

| MiniMax M2.7 229B | kit.minimax-m2.7-229b | KIT | - | hoch | hoch | |

| GPT-4.1 | azure.gpt-4.1 | Azure (EU) | 2.20 in, 8.80 out | hoch | mittel | (2) |

| GPT-4.1 mini | azure.gpt-4.1-mini | Azure (EU) | 0.44 in, 1.76 out | mittel | hoch | (2) |

| GPT-4.1 nano | azure.gpt-4.1-nano | Azure (EU) | 0.11 in, 0.44 out | niedrig | sehr hoch | (2) |

| GPT-5 |

azure.gpt-5 |

Azure (EU) | 1.38 in, 11 out | hoch | mittel | |

| GPT-5 mini | azure.gpt-5-mini | Azure (EU) | 0.28 in, 2.20 out | mittel | hoch | |

| GPT-5 nano | azure.gpt-5-nano | Azure (EU) | 0.06 in, 0.44 out | niedrig | sehr hoch | |

| GPT-5.1 | azure.gpt-5.1 | Azure (EU) | 1.38 in, 11 out | sehr hoch | mittel | |

| o3 | azure.o3 | Azure (EU) | 2.20 in, 8.80 out | hoch | niedrig | (2) |

| o4-mini | azure.o4-mini | Azure (EU) | 1.21 in, 4.84 out | mittel | mittel | (2) |

Hinweise:

(1) Die lokalen Modelle "Mixtral 8x22B" und "MiniMax M2.5" werden bis Ende April 2026 durch "Mistral Small 4" bzw. "MiniMax M2.7" ersetzt.

(2) Neuere OpenAI-Modelle ("GPT-5.2" - "GPT-5.4") sind in Azure aktuell noch nicht als "Data Zone Deployment" in der EU-Region verfügbar. Sobald diese zur Verfügung stehen, werden ältere Modelle (GPT-4.1, o3 und o4-mini) in der KI-Toolbox deaktiviert.

(3) Weitere externe Modelle über die Google Cloud ("Gemini" und "Claude") sind geplant und können zur Verfügung gestellt werden, sobald die rechtlichen Klärungen abgeschlossen sind.

Budget

Bitte beachten Sie, dass für die Nutzung der externen Modelle aktuell ein maximales Budget i.H.v. 25 USD pro Nutzer pro Monat zur Verfügung steht.

Bei Überschreitung des Budgets wird eine entsprechende Fehlermeldung bei der Nutzung eines externen Modells angezeigt (“ExceededBudget: End User=xy1234 ∂does-not-exist.kit edu over budget. Spend=xxx.xxxxxxx, Budget=25.0”). Das Budget wird am Monatsanfang um 0 Uhr (UTC) zurückgesetzt. Die lokale Modelle werden nicht auf das Budget angerechnet und die Nutzung ist auch bei Überschreitung des Budgets weiterhin möglich.

Leider gibt es aktuell noch keine Möglichkeit das aktuelle Budget einzusehen oder individuell zu erhöhen. Wir arbeiten daran...

API-Key

Die Nutzung der KI-Modelle ist auch über eine API möglich (OpenAI-kompatible Schnittstelle). Ihren persönlichen API-Key können Sie sich in der KI-Toolbox über "Einstellungen" (unten links über das Menü) -> "Konten" -> "API-Key" (ggf. auf "Anzeigen" klicken) selbst generieren. Bitte behandeln Sie Ihren API-Key wie ein persönliches Passwort und schützen Sie diesen vor unbefugtem Zugriff. Wenn Sie den Verdacht haben, dass Ihr API-Key kompromittiert sein könnte, generieren Sie ihn über die KI-Toolbox umgehend neu.

Für externe Tools ist als Basis-URL für die API i.d.R. "https://ki-toolbox.scc.kit.edu/api" anzugeben. Die Modell-ID können Sie der Tabelle oben entnehmen oder indem Sie in der KI-Toolbox mit dem Mauszeiger über der Modellauswahl den Tooltip anzeigen.

Weitere Informationen zur Nutzung der API finden Sie in der Anleitung des ZML.

Service Konten

Für die Nutzung der KI-Toolbox in Chatbots oder anderen Drittanwendungen, die einen dauerhaften API-Zugang benötigen, empfehlen wir die Nutzung eines nicht-personenbezogenen API-Keys über einen KIT Service Account. Einen Service Account können Sie am SCC-ServiceDesk über das Ticketsystem beantragen. Bitte melden Sie danach an ki-toolbox ∂does-not-exist.scc kit edu den genauen Account, damit dieser für die Nutzung der KI-Toolbox freigeschaltet werden kann.

Gruppen

Mit Hilfe von Gruppen können verschiedene Artefakte (Modelle, Wissen, Notizen, Prompts etc.) für mehrere Personen freigegeben werden, um eine gemeinsame Bearbeitung oder Nutzung zu ermöglichen. Sie können Gruppen nicht direkt in der KI-Toolbox anlegen, allerdings ist eine Gruppensynchronisation über die SCC-Gruppenverwaltung mit der Anmeldung möglich. Konkret werden Gruppen aus der SCC-Gruppenverwaltung mit dem Name in der Form "<OE>-ki-toolbox-<name>" bei der Anmeldung einer Person, die Mitglied dieser Gruppe ist, automatisch in der KI-Toolbox angelegt und die Gruppenmitgliedschaft dieser Person aktualisiert (d.h. neue Gruppen werden angelegt, eine neue Gruppenmitgliedschaft wird hinzugefügt und nicht mehr vorhandene Gruppenmitgliedschaften entfernt).

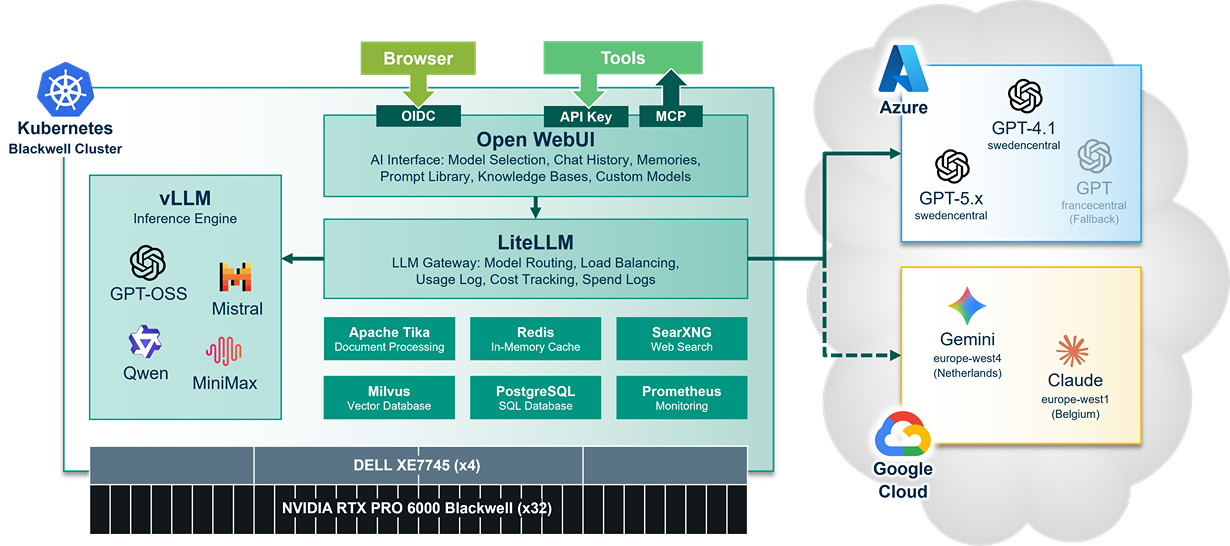

Hardware und Software

Der Softwarestack der KI-Toolbox besteht ausschließlich aus Open-Source-Software und läuft in einer Kubernetes-Umgebung auf 4 Nodes (DELL XE7745) am SCC. Jeder Node ist mit 8 NVIDIA RTX6000 PRO Blackwell GPU-Karten ausgestattet. Als Frontend kommt Open WebUI (https://github.com/open-webui/open-webui) zum Einsatz, zum Load Balancing, Kosten-Management und Logging wird LiteLLM (https://github.com/BerriAI/litellm) eingesetzt. Die lokalen KI-Modelle werden mit vLLM und LMCache (https://github.com/vllm-project/production-stack) betrieben und aus dem lokalen S3 am SCC geladen.